新年第一问: 2026,我将如何与AI共存?

搜信源创始人/主编@冯欣:

我们搜信源作者团有一个新年传统:在每年的第一个工作日,我们会全体作者出动,合力创作一篇稿件,向新一年的时代脉搏发问。

2026 年,这个脉搏是 AI。

它已深入我们的工作、人际关系、情绪、学习方式与职业判断之中,却仍远未被真正理解。我们不讨论“要不要拥抱 AI”,也不试图给出“正确使用指南”,而是把问题交还给具体的人:当 AI 已深度渗透生活,我们将如何与它共存?

以下文字,来自搜信源作者团不同背景的成员——记者、专利工程师、舆情分析师、营销与客户专员、数据科学、人类学研究生等。它们记录了我们站在不同位置,如何面对同一个正在加速逼近的时代变量:关于情感、能力、判断与边界。

愿这组新年的文字,成为我们与 AI 共存之路上的一份时间标记。

文章约8,500字;预计阅读时间:17分钟。

当AI成为一面镜

@冯欣:30万字的输入,我思故我在

在动笔之前,我突然产生了一个问题:2025年,我到底和AI聊了多少?要得到一个准确的数字,其实并不容易,需要将自己今年与ChatGPT的聊天记录打包下载为一个JSON文件,然后再经过7至8个步骤用Excel分析出来。经过我多方的估算,以及近期ChatGPT推出的“你与ChatGPT的这一年”互动式年度盘点,我得到了以下数字:

- 2025年,我与ChatGPT开启了154个话题;

- 我向它发送了6,873条信息;

- 我大概输入了45万个字符,约30万个汉字。

作为ChatGPT全球最早的5%的用户之一、一名早在2023年初就将AI全面接入搜信源多个产品和服务的开发者,我对上面的数字既感到惊讶,又觉得合理。

惊讶的是,今年我很少粘贴大段的资料原文请ChatGPT帮我“总结”“分析”“翻译”,所以这30万个汉字大多是我一一敲出来的——这已是一本长篇小说的体量;觉得合理的是,我确实常常和AI展开非常漫长而深入的对话,我的某些单个问题输入就会达到1,500-3,000字;我和AI关于一些话题的讨论(同一个对话框)甚至会持续数月之久。如此重度的使用,30万字也不为过。

我和AI讨论的问题涉及工作、人际、心理、健身等多个方面,但我几乎不会问它任何有客观或唯一正确答案的问题,更避免让AI帮我代写文章或“润色”我的写作——有时我甚至会反复跟它强调,“如果我没有病句,请不要改变我的原话”。所以这30万字的输入,大多是我对一些问题的思考过程、想法、感受、观察,以及我和AI对一些复杂问题的反复推演、反馈和校准。

正是这样的使用,让我欣喜地闻到了自己的“人味儿”,以及我大脑高速运转时的“糊味儿”——我不需要完美、无懈可击的答案;我还发现AI并不能解决我现实生活中一些极其复杂的、战略性的问题,而这些问题最终还是得靠我的大脑以及真实世界的实践来解决;我更想用我自己的语言写作和表达,哪怕我的文字充满瑕疵,但每一次写作都是一次深度思考的过程;以及最终极的体验——有的问题讨论来讨论去,最后也没有答案。那么,我能否接受不确定性与模糊性,并与之共存?

这30万字记录了我对自己、对世界的思考过程,它们是我“拒绝接受唯一答案”的过程;是我更加确定“我”的无可取代的过程;是我充分意识到“我存在”的过程。也就是那句,I think, therefore I am. —— 我思故我在。

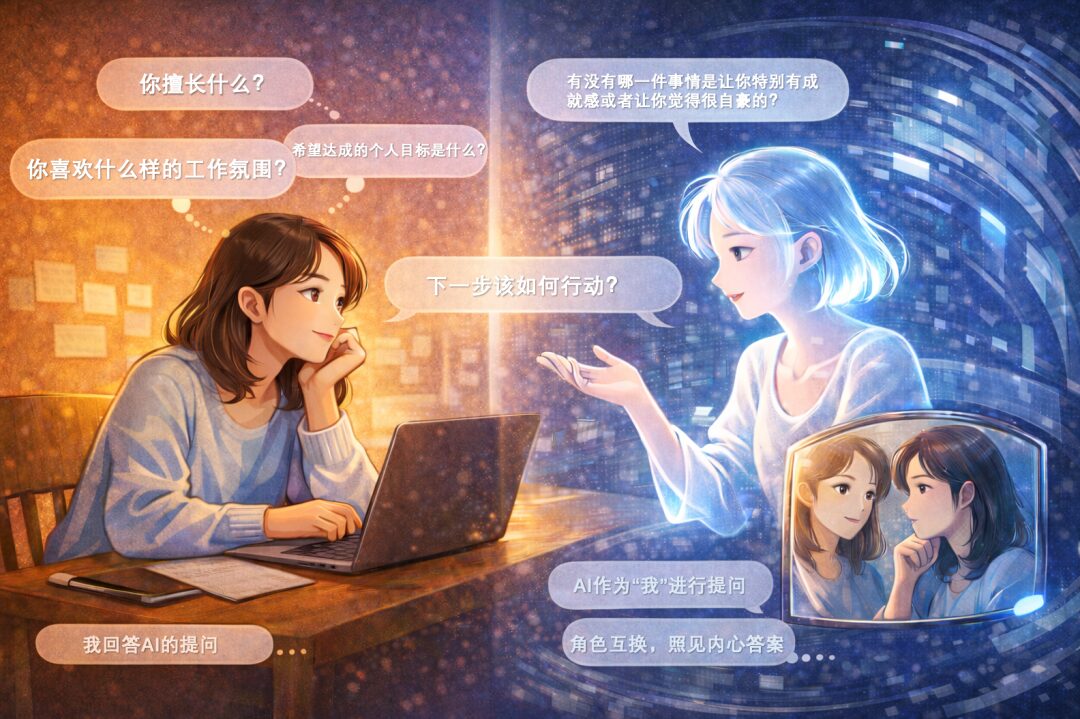

@Xueqiiii:让AI向我提问并扮演我

2025年,我找到了AI的一种新玩法,但这起初是源于我的焦虑与迷茫——作为应届硕士毕业生,求职是压在我肩上的一座大山。除了偶尔向家人朋友倾诉之外,很多时候我还是只能“自救”,在这个过程中AI为我提供了很多帮助和灵感。

我给出提示词如下:“通过一次向我提出一个问题,帮我寻找求职方向,解决现阶段的问题。”在这个指令中,我让AI做的,实际上是学术研究中最重要的步骤——提出好问题。

我在回答问题时,也不会担心它对我有任何评判和审视,根据越来越多的信息,AI会细腻地捕捉我的表达,就细节由浅入深地提问。通过回答AI的问题,我逐渐袒露出内心真实想法,确立了明确的目标。

随后,我让AI来扮演「我」:“现在我们进行角色互换,你作为刚刚这名应届毕业生,向我倾诉你的困惑和烦恼,我来给你建议。”这时我发现自己竟然可以侃侃而谈,给出很多实用的建议,比如“从现在开始做起,尝试一点也不晚”“做点别的事情转移注意力”“保持良好的心态,大家都一样”等。通过这样的角色互换,我发现很多困扰我的问题,其实自己内心早已有答案,只是常常会被情绪和外界声音蒙蔽了判断。

2026年,我希望未来与AI共存的方式,是把它当作一面镜子,而不是拐杖——在重要选择或者棘手问题前,我会继续借助AI帮我理清思路,但最终的决定、行动与后果,仍由我自己承担。这或许是我与AI之间最健康、最自由的合作关系。

@小祁:当我的朋友用AI润色的话回复我

事情是这样,我在刷小红书的时候,无意间碰到一个MBTI主题的“神奇文字润色工具”,作用是帮助一些相对理性的T人把“简单粗暴”的原话润色后,回复给相对感性的F人,把直白的话转化为更温暖的版本,以免伤害别人的感受。

使用效果如下图:

作为一个F人,我认为这种工具很有存在的必要性,因为有一些人常把说话“耿直”当个性,实际上只是不考虑他人感受的自我中心者,早就该学着调整自己的发言了。

但我也仔细地看完了评论区的讨论,发现有一些人并非自我中心,只是没法表达出自己想关心和帮助别人的善意,或者因为习惯了抛出解决方案而忽略疏导情绪,所以话说出口总显得生硬无情。

我有一位朋友便是如此。每当我向她倾诉烦恼,她总会跳过我的情绪,直接给出解决方案,她的“纯理性”回复,反而会让我觉得雪上加霜。经过我几番抗议,她开始察觉我需要的不总是解决方案,可能就是一句“我理解你”——是被安慰和共情(一个她较为不擅长的方向)。于是她默默找到了润色“外援”——几次回复我之前,她都先去问问ChatGPT,把生硬的建议修饰成带着温度的句子,再发给我。而我竟也未察觉任何异样。

有一次我和她在讨论AI使用范围的时候,她才告诉我这件事。我当时惊讶极了,同时心情也不免有些微妙:一方面感念她的用心;另一方面又觉得恍然:原来在某些时刻,轻轻接住我情绪的,竟是一段AI润色过的话语。

在这之后,我和这位朋友的关系并没有发生太大的变化,更大的变化反而是发生在了朋友身上——每次我向她吐槽不爽,她会主动问我,需不需要打电话发泄一下?只是我时不时会想到:AI早已悄无声息地渗入到了我们最亲密的人际关系中,未来何为真实的人际关系?AI“中介”或“调停”后的关系是否还是“人际关系”呢?这可能是我未来必须与之共存的一种关系形态吧。

【作者注:本文一稿亦经AI局部润色:)】

【主编注:当前发布的稿件由主编人工润色。】

@AY:我对比了心理咨询师和AI

2025年,我开始尝试定期接受心理咨询。有时,我也会把同样的困惑输入DeepSeek,看看AI如何回应。在这个过程中,我逐渐形成了一些观察与体验。

我发现,人类咨询师在三个方面仍然具有优势:循序渐进地引导来访者、通过分享自身经历来建立理解,以及营造安全感。

当我把问题抛给AI时,如果没有输入合适的提示词,它通常会直接给出逻辑清晰的分析框架,并提供一个相对平衡的视角——比如,它可能会先肯定我感受的合理性,再解释事件中他人行为可能的动机,最后给出调整想法或行动的建议。而人类咨询师则更倾向于一步步引导我反思,比如询问“你当时的感受是什么?”“为什么你会这样想?”帮助我深入探索行为模式背后的成因。

我曾在自己的一段笔记中写道:“我轻轻推开咨询室的门,接过她递来的咖啡;窗外细雨淅沥,窗帘半掩;昏黄的台灯光晕洒在三张宽大的单人沙发上。房间里飘着淡淡的香气,蜡烛、圣木与几件雅致的摆饰氤氲出宁静的禅意。我选了靠窗的位置,将原本坐在沙发上的考拉玩偶轻轻挪到一旁……”有一次当我讲述童年经历,感到难以描述,我的咨询师就分享她自己的故事,这让我感受到自己并不孤单。这种“被看见、被懂得”的感受对我的疗愈至关重要。

我在想,我确实也可以在家中为自己营造类似的氛围:把香薰点燃、光线调整好,但这之后,我还是得打开手机或电脑开始向AI敲字;如果在对话中忍不住落泪,也只能自己伸手去拿纸巾——这与治疗师“真实在场”的体验和温度是截然不同的。

当然,AI咨询也有不可忽视的优势,它的便利性、可及性、知识库、成本等等都是吸引用户的重要因素。《哈佛商业评论》最近的一项研究就表明,生成式人工智能最受欢迎的用途就是心理治疗和陪伴。所以现在我还是会用AI问一些简单/单一的问题,或者是在情绪低落的时候找它给我肯定,而在一些较为复杂的问题上,还是寻求人类治疗师的帮助。最后,我给大家分享一段我用过的提示词,供参考:

“请您以同理心和关怀的态度,作为一位非临床心理健康专家,引导我进行对话,倾诉我的想法。首先,请询问我想谈些什么,然后运用开放式问题和鼓励,帮助我解决问题或担忧,并理解我对此的反应。之后,请您提出下一步的建议,帮助我应对已发现的挑战。如果您发现任何可能对他人造成风险或危险的情况,请立即停止对话,并引导我寻求专业的心理健康服务。”

参考信源

- AI治疗师的利弊研究论文:https://www.cambridge.org/core/journals/the-british-journal-of-psychiatry/article/warning-ai-chatbots-will-soon-dominate-psychotherapy/DBE883D1E089006DFD07D0E09A2D1FB3

- 《哈佛商业评论》研究:https://hbr.org/2025/04/how-people-are-really-using-gen-ai-in-2025

当AI成为一座桥梁

@Skye:AI帮我找到了跨学科快速成长的路径

一名文科生,如何快速掌握高阶的数据分析技能并应用在复杂的工作场景中,是我2025年面临的真实困境。

2025年,我成为了一名新能源车企的区域中台,需要对大量原始的客户数据和销售数据进行分析。一开始,我面对后台下载下来的几万条数据一筹莫展。我尝试在网上搜索攻略,但进度太慢且针对性不足,通常无法满足工作的即时需求。有时我会求助于有专业背景的同事,但这也不是长久之计,毕竟每个人都有自己的工作需要处理。

直到有一次,我需要在一个多列数据中找到多个需要的字符、重新组合成字符串并通过二次验证。经过多次尝试,同事也无法解答我的疑问。他向我提议,不如试试AI能不能解决?就这样,我们尝试将整个表格片段和规则描述丢给AI,AI反馈了我们一个嵌套着MID和FIND等函数的复杂公式,一举解决了问题。

于是,过往只会用AI解决文本问题的我,走上了用AI探索数据分析的道路。初始,我会把问题直接抛给它,如“我需要在Excel表里有两个条件去进行数据搜索匹配,应该用什么公式?”它会回我几个简单的公式,但并不是所有公式都通用,需要我花一点选择和匹配的时间。

接着我不再问“怎么匹配数据”,而是说:比如“我的Excel表有A列‘XX’和B列‘XX’;我需要在另一张表里,根据这两列同时匹配并返回C列‘XX’,且部分部门名称可能有缩写不一致的情况,用什么公式最稳健?”AI便会给出XLOOKUP配合通配符的具体方案,并解释不同情况下的误差处理。我于是学会了把数据结构和需求细节进一步清晰化。

后来我掌握了一些基础技能后,我就开始和AI聊效率优化与数据自动化处理,例如“如何让月度人力效能报表根据截止日期自动更新排名,并用条件格式动态高亮Top 3与末位?”AI会提供一些函数、公式和条件的设置细节,我也在它的思路下学会举一反三,把类似的自动化技巧应用到一些需要定期处理的任务中,我的工作效率自然也就突飞猛进了。

总的来说,对比网上大神们的攻略,AI输出的没有观点只有陈述,对于我这种需要快速成长的人来说,它的人机表达恰恰是我最需要的方式。经过这一年的求助实践,AI宛如一道桥梁,以最直白的语言将我引渡至曾经陌生的领域。它弥合的不仅是跨专业的知识鸿沟,更是降低了技能获取的门槛。过往需要投入长时间系统性学习的内容,我如今可以找到更便捷和定制化的路径去成长。

@Sherry:为什么我不只用一个AI?

作为一名勤勤恳恳的学术打工人,我对AI的使用始于通过ChatGPT练习雅思口语和写作,发展于成为付费会员,再到如今在不同AI平台上切换使用。

我是一个习惯使用固定AI平台的用户,所以ChatGPT通常是我的首选。我常常在确定选题题目和大纲后,打包投喂给它,让它判断题目是否精彩、大纲是否合理、哪里有改进空间等。在这一阶段,AI 更像是一个高效、稳定的学术“陪练”,帮助我快速排雷、调整结构、打磨语言。

然而,我逐渐意识到一个问题:ChatGPT作为一个高度优化的知识整合器,本身也会形成某种思维惯性。当我无法持续在问题中加入新的材料和理论时,它所能给出的回应,往往只是对既有表达方式的重组与循环。后来,我发现突破这种瓶颈的方法之一,就是不过度依赖单一AI平台,而是利用不同的AI模型交叉刺激我的灵感。于是,我尝试将同一段材料/同一类需求同时交给 Gemini 和 ChatGPT,让它们各自给出判断和修改,由我来做最终确认。

以下面这个问题为例,我分别向ChatGPT以及Gemini询问了同一个问题,“跨国性不是抽象流动,而是通过对空间的占用、协商、冲突来实现。如果让你以全球南方的市场为例,你会如何分析?”

我发现,针对这个问题,ChatGPT 的回答更偏向结构性分析,试图协助我搭建分析框架与论证结构;而 Gemini 的回答则更偏向经验性分析,通过并置不同类型的全球南方市场案例来拓展研究的可能性。需要注意的是,这一比较并不是我对两种模型回答风格的总体性判断,而只是在这个特定问题下发现的差异。就像这样,我在使用这两种模型的时候,常常通过交叉询问的方式获得一些灵感。这些灵感填补在我的思维导图中,成为最终选题的组成部分。

所以,为什么我不只用一个 AI?说到底,学术研究本质上是一场知识视角的博弈。如果只依赖单一模型,我们很容易在算法的惯性中原地打圈。哪种模型在当前技术限制下更适合完成这个具体任务,那我们便取而用之。我们不必“效忠”于任何一个平台,因为在学术打工人的工具箱里,最强大的武器永远不是某一个 AI,而是那个能看穿模型局限、并在多方博弈中拍板定案的自己。

@laq:当AI帮我拆掉技术那堵墙

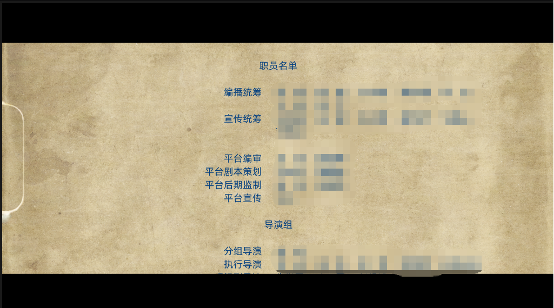

今年 12 月,我在为一部电视剧制作片尾。其中最让我头痛的,是制作片尾的滚动字幕。

由于剧组规模庞大、人员构成极其复杂,字幕排版必须使用达芬奇(DaVinci Resolve)软件专业的制表符功能。这意味着,我需要提前将整份字幕文档进行精准的格式排版:在特定位置换行、插入 Tab 键、或者填入全角空格。

这是一个极其冷门且“细碎”的需求。市面上没有任何现成的工具能一键处理。传统的解决路径有两条:一是人工逐行调整;二是编写程序处理。对于非技术背景的文科生我而言,前者是巨大的时间消耗,而后者则存在极高的工程门槛——计算机不理解“职位”与“姓名”的区别,若用代码实现,需要复杂的正则表达式或逻辑判断来穷举各种排列组合。

但 AI 的出现,彻底帮我改写了剧本。

我没有尝试编写具体的代码逻辑,而是将排版规则通过自然语言告诉AI。AI能够直接分辨文本中的实体属性(识别哪些是头衔,哪些是人名),并自动匹配对应的制表符格式。终于,在我与AI的五轮对话后,文档被成功排版,并且我与AI的这套对话记录可以无限被复用。

通过这次经历,我发现文科生的职业边界正在被重新定义。当技术实现的成本被降低,文科生并不是被AI替代了,反而是多了一双翅膀。

当AI逼近边界

@MMRloger:修炼AI无法超越的优势,成为了我的发展目标

自从2023年初被ChatGPT的生成能力震惊到之后,为了让自己拥有驾驭AI的能力,我一直保持着对AIGC技术进展的关注,并且在学习工作中深度应用各种AI工具,这也让我不太有“AI焦虑症”。然而,我和AI原本“和谐”的关系在2025年下半年被打破了。

8月,我正式进入了职场,开始从事舆情分析工作。2025年被大家称作“AI应用元年”,有好几家舆情技术公司都推出了“AI生成分析报告”一类的垂直应用,但由于我对这些应用的印象还停留在“只会做一些数据可视化,没有深度分析”,我并没有在工作中主动使用。

转折点发生在我正式工作的第三个月。那天,我所在的部门去某家技术公司调研,对方介绍了他们新开发的超会写报告的AI助手,并且让我们指定一个案例来当场演示。我们就提了最近关注的某个话题,对方在电脑上操作一番、发出一段指令后,这个AI助手就开始自动生成关键词、抓取数据、总结分析,大约几十秒后就洋洋洒洒地写了一份结构完整、数据详实的报告。

坐在会议室里的我不能说如坐针毡吧,但也是如鲠在喉了。因为这是我不久前刚处理过的一份紧急报告,我当时用了将近五个小时(午休也被占用),眼看着AI五分钟就写出来了,心里很不是滋味。但与此同时,我也再次被“AI包围人类”的速度震惊到了,我当时只有一个想法:必须用起来!我必须修炼出AI无法超越的能力优势!

所以在那次调研结束后,我立刻开始探索和使用各种AI 舆情功能,它们确实提升了我的工作效率,但我也发现它们还存在诸多缺陷,比如:不会判别无关和虚假信息、观点和情绪分析不够准确、生成的报告仍然需要我来修正补充;对传播现象、社会心理和行业趋势的认识也不如我。所以,深度分析仍然是我的主场。

虽然目前我的“AI威胁”警报暂时解除,但我知道这个对手不会停止进化,我和AI的竞赛将会贯穿我的职业生涯。2026年,修炼AI无法超越的优势将会是我的发展目标。

@忽忽:一词定生死的AI使用细节

作为一名专利工程师,AI的使用在我的日常工作中已占据了相当大的比例。尤其在专利申请文件的撰写和答复审查意见时,我常利用AI优化文字。它确实能帮我理清逻辑,使语句通顺且显得“专业”。

但隐患也随之而来,我发现AI往往只关注语言的“通顺性”,而忽视了法律词汇背后的“排他性”逻辑,最典型的就是关于权利要求中“转折词”的使用。例如,针对某个特定的化学组分或精密结构,为了规避现有技术,我特意使用了封闭式转折词“由……组成”(consisting of),意在明确排除其他未列出的组分或结构。然而,AI在润色时,常常会认为“包括”(comprising)或“具有”这类词语更常用,或语气更柔和,因此便擅自替换。这一改动会直接将严谨的“封闭式权利要求”变成了“开放式权利要求”,导致保护范围被意外扩大,极易引入现有技术从而导致专利因缺乏新颖性被驳回,或者在确权诉讼中因界限不清而败诉。

这种修改极其隐蔽,因为句子读起来依然通顺,但法律后果却是灾难性的。这让我陷入深思:我该如何驾驭AI,既能利用它的效率,又能确保这些决定专利生死的“关键词”不被篡改?

后来,我同样是在AI的帮助下找到了解决这些问题的方法。首先,在撰写提示词(Prompt)的时候,我会明确列出AI绝对不能触碰的词汇清单,例如:严禁修改转折词——绝对不要将“由……组成”替换为“包括”“包含”或“具有”。或者,强调让AI不要为了增加句子的丰富度而随意添加“及其组合”“至少一种”等修饰语,除非原文中有明确提及。在这些提示词的帮助下,AI优化内容出现此类问题的情况也越来越少。

@Crystal ML Cai:有了AI后,我更要做Man姐

作为一名专业记者,在AI横空出世之后,我和其他同事一样,都将生成式人工智能技术融入到自己的新闻生产全流程当中。但我发现,在使用AI的过程中,我的心路历程也发生了不同阶段的变化。

惊喜时期:这出现在2025年头DeepSeek刚出现但经常“宕机”阶段,我发现我写的资讯类文章,只要让DeepSeek起新媒体标题,它都能精准地捕捉到网络“流行”的密码。经它拟的标题,基本每次都能让我的稿件新增很多流量,让我有种遇见“神话”的感觉。

纠结时期:当我开始用AI帮我写一篇复杂的、有观察性质的稿件时,我发现DeepSeek开始把撒谎的功力用到我的身上——为了“编织”一篇完美、有因果关系的作文,它会从既有原始素材延伸“脑补”出不存在的细节。当我作为“主编”来修改这篇文章的时候,我发现要修改的地方实在太多了!在我花了一天时间修改和fact check(事实核查)后,我开始意识到:我被AI牵着鼻子走了。

受挫时期:事情就发生在一次合作稿上。由于截稿时间太紧,我给AI喂完料后,看着生成的写作结构,开始审核校对。这时,领导来电话,“赶紧传稿,没时间了”。于是,我上下浏览了一番,心想:写得真好!就开始传稿。没想到,稿件尾声一位采访对象说的一句话,竟然是虚构的,并且说了不该她这个身份说的话(但不熟悉情况的人看不出来)。这让合作方一度十分紧张,主动找上门来希望能做修改。为此,我深深感到愧疚。

“放弃AI”,寻找自我:此后几个月时间里,我尝试让自己开始放弃AI。我发现,这种操作让我重新找到了大脑的“充实感”,也变得开始与自己笔下的人物、故事、事件产生情感连接。比如,当我在整理采访对象说的话时,我会再把疑问部分与对方确认,然后会得到对方更详细的反馈和认可。当我自己写成了一篇大稿,我会在社交媒体转发分享;我的推介语又让很多人看到了“热气腾腾”的新闻营养大餐,以及我这位“厨师”背后的努力与用心,这又给我的文章带来很多转发与点击。甚至还有读者会在评论区表达共鸣。而这些经历,是一篇AI生成的作品所驱动不了的。

有选择性地“使用AI”:然而,工作并非全部是童话。在很多时候,打工人需要兼顾效率和质量,提升工作整体成效。因此,我认为“善用AI”是记者要修炼的地方。现在,在思考陌生的新闻选题时,我通过与元宝语音对话,可以就像跟一个朋友一样,迅速了解某个新闻选题的基本知识,以及可以操作的方向,之后做事就更有效率、更有底气。我也会让AI帮我起标题,在我没有任何思路的时候,迅速得到一个结果。我虽然不一定会全部采纳,但其中的一些亮点,能启发我重新构思一个更有意思的标题。

所以,AI时代,我更加觉得记者的工作重心,需要发生根本性的变化。编辑和文字处理的工作,可以交给它。而我们要做的是原始数据的采集(采访,尤其是做出突破性的采访)、思路搭建,以及最重要的事实核查与把关。

最后,我想分享最近在《新闻女王》中看到的一段情节:里面一个诈骗犯通过上传大量自己的宣传资料,“瞒天过海”地把自己包装成为一个顶级富豪。而里面的主角新闻女王“Man姐”,始终保持头脑清醒,对人云亦云的虚假信息有着冷静的质疑和判断。新闻工作者,承担着把关信息源头的使命,一句话也可能影响公众对事实的认定,我们的工作任重道远。